TL;DR

- Этичный AI-маркетинг - это не "быть хорошими". Это управление юридическим, репутационным, операционным и коммерческим риском.

- Главные зоны риска: персональные данные, синтетические лица/голоса, фейковые отзывы, непроверенные claims, авторские права, bias, манипулятивные механики и отсутствие disclosure.

- На 12 мая 2026 года важные ориентиры: EU AI Act, NIST AI Risk Management Framework, OECD AI Principles и Закон Республики Казахстан "Об искусственном интеллекте".

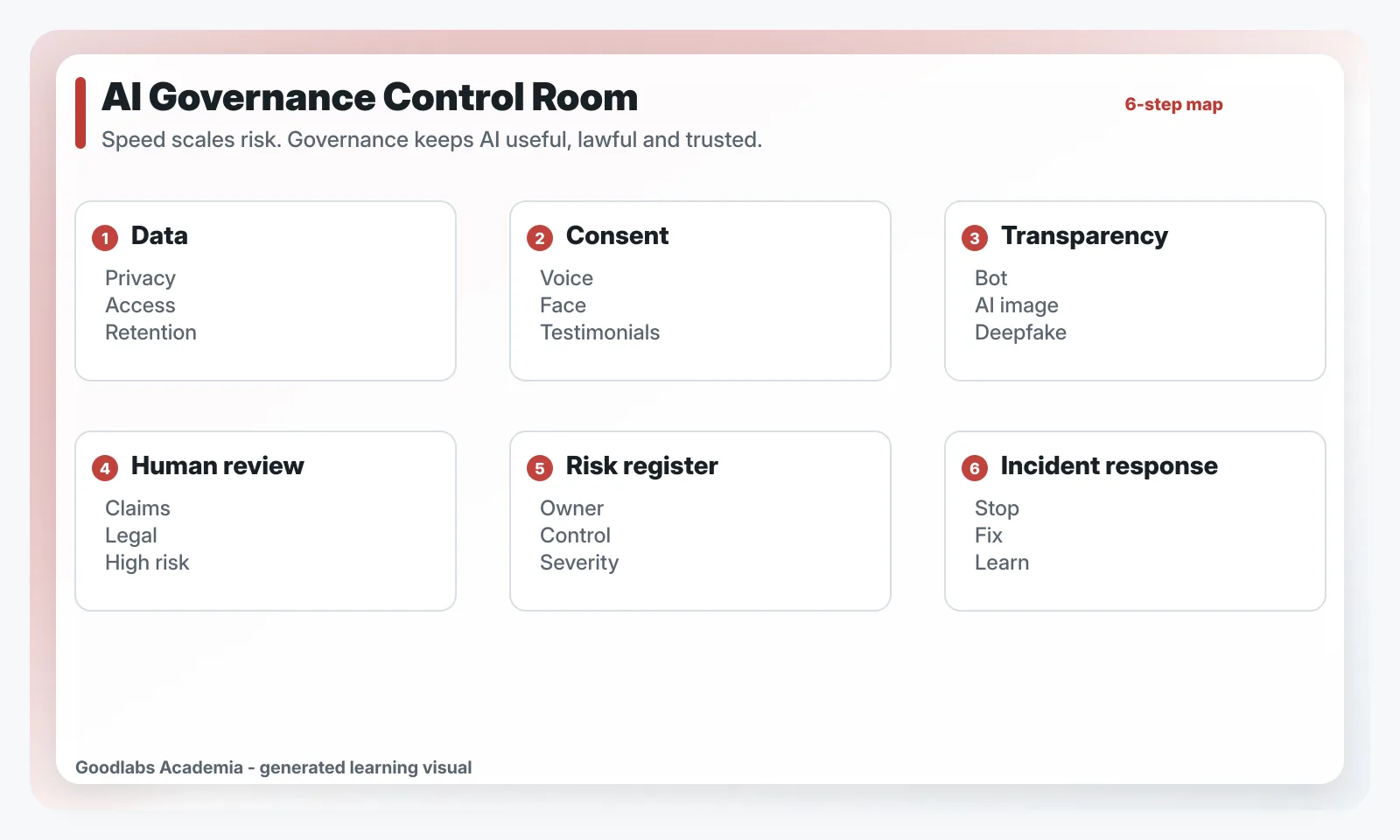

- СМО нужен простой AI governance pack: правила данных, disclosure, consent, human review, risk register, approval matrix, incident process.

- Будущее маркетинга не в том, чтобы скрыть ИИ, а в том, чтобы использовать его прозрачно и сильнее помогать клиенту.

1. Почему этика стала частью P&L

ИИ дает маркетингу скорость. Скорость без контроля создает новые риски. Команда может за день сгенерировать сотни креативов, тысячи текстов, синтетические голоса, лица, лендинги, персональные предложения и автоматические ответы клиентам. Если процесс слабый, ошибка масштабируется так же быстро.

Что может пойти не так:

- в публичный AI-сервис загрузили базу клиентов;

- сгенерировали изображение, похожее на реального человека или чужой бренд;

- опубликовали AI-отзыв от несуществующего клиента;

- сделали финансовое обещание без юридической проверки;

- автоматический бот ввел клиента в заблуждение;

- модель дискриминирует сегменты или исключает людей из предложения;

- агент прочитал prompt injection и отправил лишние данные;

- SEO-команда создала тысячи низкокачественных страниц;

- компания не смогла объяснить, где ИИ участвовал в решении.

Последствия: штрафы, судебные претензии, блокировки платформ, PR-кризис, потеря доверия, падение конверсии, внутренние конфликты. Поэтому AI governance - часть маркетинговой операционной модели, а не отдельная "юридическая тема".

2. Правовые ориентиры на 2026 год

Это не юридическая консультация, а карта ориентиров для СМО.

| Источник | Что важно маркетингу |

|---|---|

| EU AI Act | риск-ориентированный подход, требования к прозрачности, правила для deepfakes и некоторых AI-generated materials |

| NIST AI RMF | практическая рамка Govern, Map, Measure, Manage для управления AI-рисками |

| OECD AI Principles | human-centered values, transparency, robustness, accountability |

| Закон РК "Об искусственном интеллекте" | принципы прозрачности, безопасности, защиты данных, ответственности и развития AI в Казахстане |

| Законы о персональных данных | нельзя использовать клиентские данные без правовой основы, целей, контроля доступа и защиты |

| Правила рекламных платформ | отдельные требования к синтетике, политике, медицине, финансам, дискриминации и claims |

EU AI Act был принят как Regulation (EU) 2024/1689. Часть требований вводится поэтапно. Для маркетологов особенно важно следить за прозрачностью синтетического контента, deepfake-рисками и запретами на манипулятивные практики. Закон Казахстана "Об искусственном интеллекте" размещен на Adilet и, по опубликованной карточке документа, принят в 2025 году. Для локального бизнеса это сигнал: ИИ перестал быть серой зоной, governance будет становиться нормой.

3. Data privacy

Маркетинг работает с чувствительными данными: контакты, покупки, поведение на сайте, звонки, город, язык, интересы, финансовые признаки, жалобы, поддержка. ИИ делает анализ быстрее, но не дает автоматического права использовать эти данные как угодно.

Минимальные правила:

- собирать данные под понятную цель;

- не загружать лишние персональные данные;

- анонимизировать или псевдонимизировать выгрузки;

- ограничивать доступ по ролям;

- проверять настройки платформы и договоры;

- хранить источник и дату выгрузки;

- удалять временные файлы;

- разделять рабочие черновики и production data;

- фиксировать, где используется AI.

Особенно осторожно с сегментацией. Например, "люди с высоким доходом", "беременные", "клиенты с проблемами здоровья", "финансово уязвимые" - это не просто маркетинговые группы. Такие признаки могут вести к дискриминации, манипуляции и правовому риску.

4. Прозрачность и disclosure

Disclosure нужен не всегда одинаково, но маркетинг должен иметь правило. Если ИИ помог отредактировать текст, обычно достаточно внутренней отметки. Если пользователь общается с ботом, он должен понимать, что это бот. Если бренд публикует синтетическое фото как иллюстрацию, иногда уместно указать "AI-generated illustration". Если используется deepfake, синтетический голос или виртуальный амбассадор, disclosure становится гораздо важнее.

Практичная матрица:

| Ситуация | Disclosure |

|---|---|

| ИИ помог написать черновик статьи | внутренний editorial log |

| AI-illustration в образовательном материале | alt text или подпись, если важно для контекста |

| Чат-бот в поддержке | явно сказать, что отвечает AI assistant |

| Синтетический ведущий | раскрыть, что это виртуальный/AI presenter |

| Клонированный голос сотрудника | согласие + disclosure по контексту |

| Реалистичный deepfake | высокий риск, legal review обязателен |

| AI-отзыв клиента | не использовать как отзыв |

Пользователь не должен чувствовать, что его обманули. Доверие трудно восстановить, если бренд был пойман на fake human proof.

5. Авторское право и креатив

AI-креатив находится в сложной правовой зоне. В разных юрисдикциях по-разному оценивают авторство, training data, степень человеческого участия и права на результат. Для СМО важны практические правила:

- не просить модель "сделай в стиле живого художника X" для коммерческой рекламы;

- не использовать сходство с публичными персонами без права;

- не копировать чужие кампании через AI;

- хранить prompt, source assets, edits и финальную версию;

- добавлять человеческий creative direction и editing;

- проверять коммерческие условия инструмента;

- использовать лицензированные источники, если риск высокий;

- отдельно проверять товарные знаки и персонажей.

Если компания строит бренд на уникальном visual identity, нужно не просто генерировать картинки, а создавать свои правила: композиция, палитра, типографика, camera language, product truth, banned styles.

6. Human review

Не все AI-результаты требуют одинакового контроля. Сделайте risk tiers.

| Риск | Примеры | Контроль |

|---|---|---|

| Low | идеи постов, черновики captions, moodboards | редактор / владелец задачи |

| Medium | email клиентам, SEO-статья, лендинг, реклама | редактор + performance/brand review |

| High | финансы, медицина, дети, персональные данные, deepfake, legal claims | legal/compliance + owner approval |

| Critical | автономное изменение бюджета, персональные решения, публичные кризисы | не автоматизировать без строгой системы |

Маркетинг должен знать, где человек обязан остановить процесс. Human-in-the-loop - не символическая галочка, а конкретный чек: кто проверяет, что проверяет, где ставит approval, что происходит при отказе.

7. AI risk register для маркетинга

СМО полезно вести простой реестр рисков:

| Риск | Где может случиться | Вероятность | Ущерб | Контроль | Owner |

|---|---|---|---|---|---|

| Утечка данных | выгрузки CRM в AI | средняя | высокий | анонимизация, доступы | CRM lead |

| Fake testimonial | SMM/video | низкая | высокий | запрет, review | brand lead |

| Непроверенный claim | ads/landing/email | средняя | высокий | legal checklist | performance lead |

| Prompt injection | agent/web research | средняя | средний | tool limits, evals | marketing ops |

| SEO spam | content production | средняя | средний | quality review | SEO lead |

| Bias в сегментации | CRM/personalization | низкая-средняя | высокий | audit features | analyst |

Реестр не должен быть бюрократией. Он нужен, чтобы команда заранее знала, где нельзя ускоряться без тормозов.

8. Будущее: что изменится для маркетинга

AI будет становиться не отдельным инструментом, а встроенным слоем в CRM, CMS, рекламные кабинеты, BI, дизайн, video production, customer support и search. Маркетолог будет меньше заниматься ручной сборкой материалов и больше управлять системой: ставить цели, проверять данные, проектировать эксперименты, контролировать качество, защищать доверие.

Вероятные изменения:

- больше персонализации, но выше требования к privacy;

- больше видео и аудио, но выше требования к consent;

- больше AI-search, значит контент должен быть точным и структурированным;

- больше agents, значит нужны approvals и logs;

- меньше ценность "просто написать текст", больше ценность реального опыта;

- меньше терпимость к фейковому social proof;

- больше запрос на human brand: позиция, ответственность, лицо, голос.

Парадокс: чем больше ИИ в маркетинге, тем ценнее человеческое доверие.

9. Практическое задание

Соберите AI governance pack на 2 страницы:

- Какие AI-инструменты разрешены.

- Какие данные запрещено загружать.

- Где нужен disclosure.

- Где нужен consent.

- Какие темы требуют legal review.

- Кто approves high-risk content.

- Как хранится библиотека промптов.

- Как фиксируются источники и факты.

- Что делать при ошибке или жалобе.

- Кто владелец AI governance в маркетинге.

После этого возьмите одну реальную AI-задачу и прогоните ее через risk tier. Если она high-risk, опишите контроль до запуска.

10. Видео

- Видео NIST: Introduction to the NIST AI Risk Management Framework (AI RMF 1.0) - короткое объяснение подхода к AI risk management.

- Видео OpenAI Academy: Introduction to GPTs - полезно для понимания, почему custom assistants требуют правил и ограничений.

Что почитать

- EU AI Act official page

- Regulation (EU) 2024/1689 on EUR-Lex

- NIST AI Risk Management Framework

- OECD AI Principles

- Закон Республики Казахстан "Об искусственном интеллекте" на Adilet

- OpenAI API: Data controls

Главный совет

Не пытайтесь спрятать ИИ. Сделайте его управляемым. Команды, которые заранее строят прозрачность, consent, human review и risk management, смогут использовать ИИ быстрее именно потому, что им не придется каждый раз тушить последствия.